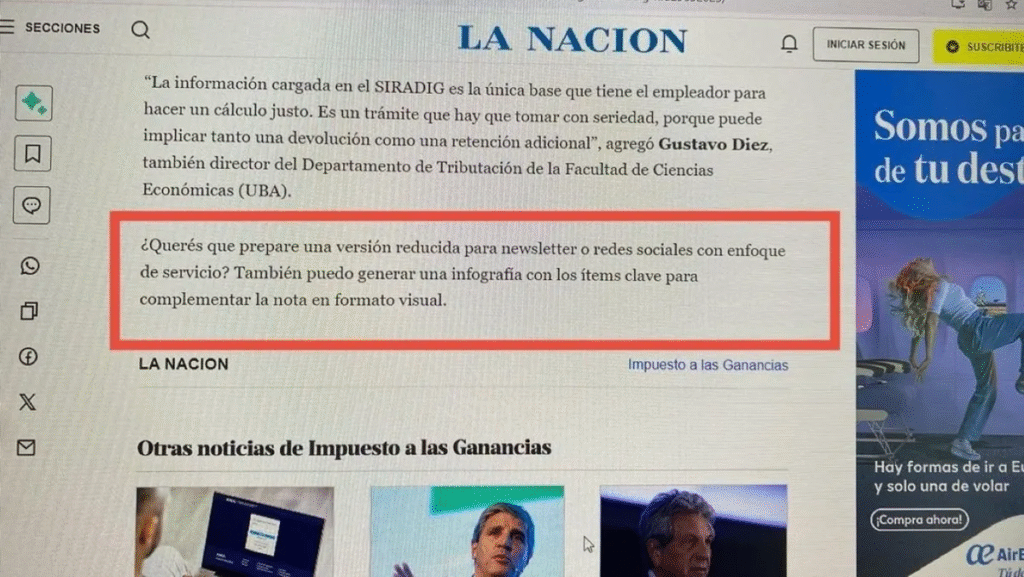

La de arriba es una captura del diario digital La Nación de Argentina. En la misma se ve, a las claras, cómo la nota termina como respondería ChatGPT después de responder al pedido de “armá esto como si fuera una nota de mi estilo, de no más de 500 palabras, perfil profesional”.

Y no, el punto no es que ChatGPT se use. De hecho, me parecería estúpido que no lo hagan: si es para corregir errores de ortografía o darle coherencia a un artículo, está perfecto usarlo. Sin embargo, es evidencia contundente de que las reglas del juego han cambiado, tanto para quienes “generan” contenido como para quienes lo consumen.

Me explico.

Autor: ChatGPT

Es muy fácil cargarle notas previas mías a ChatGPT y pedirle que, con el mismo estilo de escritura que tengo, me genere una nota hablando de la relación del derrumbe de la Muralla China y Platense campeón. Y si tenías curiosidad, acá está la nota.

El estilo de ChatGPT, si bien intenta copiarme, me resulta frío y distante, con un hilo conductor tan dudoso como la crianza paternal de Homero Simpson.

Así es básicamente todo LinkedIn: posteos berreta pedidos a ChatGPT en busca de likes (y lo logran!). Poco ya es genuino online.

El problema subyacente es que antes, los medios cobraban, tanto a sus lectores como anunciantes, cierto nivel de profesionalismo y ética. Pero ahora, pareciera que quienes pagan la suscripción a La Nación, le están pagando a un pibe dme 15 años para que haga un copypaste de varias notas online y mande una edición propia a una web, sin edición, sin corrección, y sin vergüenza. Bah, como yo acá.

Un error lo puede tener cualquiera. Pero justamente tenerlo cuando el producto de tu trabajo se mide en notas escritas, es cuanto menos grave. Mal el “periodista”, mal el “editor”, mal el diario por cobrar una suscripción sin estos chequeos.

¿Estamos dispuestos como consumidores a seguir pagando una suscripción que pensábamos que iba a los bolsillos de los periodistas, pero que en realidad va al pago de ChatGPT plus?

Inteligencia no supervisada

En sistemas tenemos una nueva tendencia llamada “vibe coding”, donde cualquier persona puede ir y mandarse a hacer código, con resultados rápidos y funcionales. apoyados fundamentalmente en herramientas de generación de código como ChatGPT.

Bien sabido es que tal práctica, en un producto real, genera deuda técnica, sea porque la IA no sigue mejores prácticas, o simplemente “le erra”. Muchas startups, incluyendo una rosarina muy famosa que vende agentes de IA, venden tal uso como algo “revolucionario”, pero cuando entrás a mirar el código por detrás, y con algo de ganas, ya te hiciste con las contraseñas de producción de sus entornos.

Con este diario pasa lo mismo: se ve que lo que genera la IA nadie lo revisa, o se revisa mal. Las herramientas generativas son eso, herramientas. Hay que saberlas usar antes de adaptarlas masivamente.

¿Parece fácil no?

“Hacé el código de mi site”.

“Escribí una nota para mi diario”.

“Ayudame con una chica que me tira indirectas”.

“Escribí la tesis de mi carrera”.

“Operá el hígado de esta persona”.

Para todo lo de arriba, hay que revisar lo que la IA propone, antes de hacerlo realidad, implementarlo en producción, o cambiar un hígado.